インサイト

⑧ フィジカルAIの覇者は誰か? NVIDIA Cosmosがロボティクス学習を再定義する

Superb AI Japan

2026/03/20 | 15 min read

![[フィジカルAIシリーズ#8] フィジカルAI最強はNVIDIA?徹底分析](https://cdn.sanity.io/images/31qskqlc/production/6b8443bae9405e806ec1f8bfc1c18c3c5d875706-2000x1125.png?fit=max&auto=format)

フィジカルAIは、従来の言語モデル(LLM)や画像生成にとどまらず、ロボット、自動運転車、ドローン、スマートファクトリーといった「物理システム」に統合され、現実世界と直接相互作用する次世代AIです。

その動作原理は人間の認知プロセスと非常に類似しており、以下の3段階の循環構造に基づいています。

① 認知(Perception):カメラ、LiDAR、各種センサーを通じて周囲環境を把握する段階

② 判断(Decision):取得した情報を基に推論・意思決定を行う段階

③ 行動(Action):決定内容をロボットアームや移動機構などを通じて物理的に実行する段階

しかし、フィジカルAIの実用化においては重大なボトルネックが存在します。それが「データギャップ(Data Gap)」です。

LLMがインターネット上の膨大なテキストデータを学習対象とするのに対し、フィジカルAIは必ず「現実世界に基づいたデータ」を必要とします。このデータギャップは単なる量の問題ではなく、「質」と「種類」の問題です。

フィジカルAIが学習すべきデータには、物理的相互作用、因果関係、時空間的文脈が含まれます。例えば、「カップがテーブルの上にある」という認識だけでなく、「テーブルの端から押せば落下する」という因果関係まで理解する必要があります。

このような特性により、現実世界でのデータ収集は極めて困難となり、「合成データ(Synthetic Data)」が実質的に唯一の現実的な代替手段として注目されています。

2. 新たなパラダイム:シミュレーションを高度化するワールドファウンデーションモデル(WFM)

この課題に対し、NVIDIAは「ワールドファウンデーションモデル(World Foundation Models, WFM)」という新たな概念を提示しました。

WFMは、単なる3Dアセットのレンダリングを超え、「物理世界の状態を理解し、合成データとして生成する基盤モデル」を指します。

これは、シミュレーションデータ生成の在り方を根本から変革するものです。

- 過去(職人方式): 従来の手法では、Isaac Simなどを用いて環境構築、アセット配置、アクターの挙動設計をすべて手動で行う必要があり、高度な専門知識と多大な工数を要していました。

- 現在(生成方式): 一方、CosmosのようなWFMでは、テキスト・画像・動画といったプロンプトを入力するだけで、シナリオ全体を自動生成することが可能です。

これにより、シミュレーション開発は「コードと3Dモデリング中心」から「自然言語プロンプト中心」へと移行しつつあります。

さらに、Cosmos Predict 2.5はテキスト・画像・動画生成を単一モデルに統合しており、3D制作の専門知識を持たない開発者でも、大規模な学習シナリオを生成できるようになりました。

このように、WFMは合成データ生成を「自動化」かつ「民主化」し、「アイデア → 合成データ → 学習済みポリシー」というパイプライン全体を大幅に短縮します。

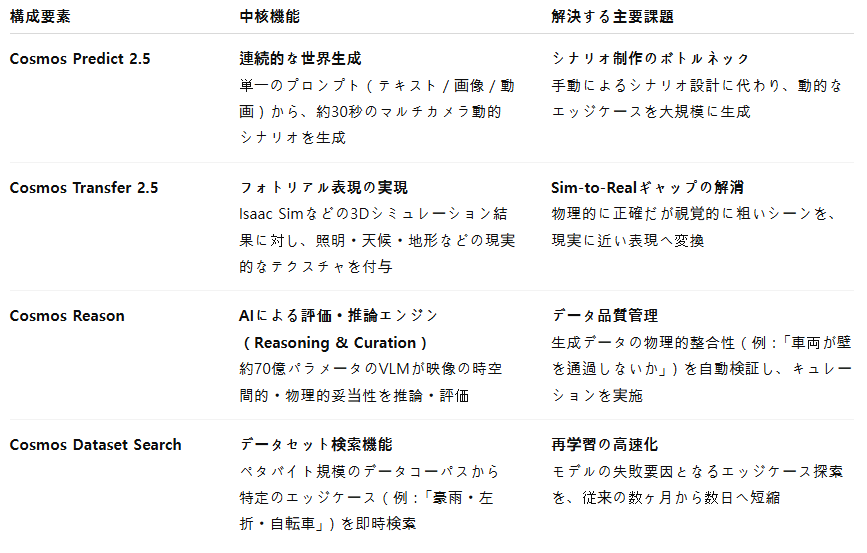

NVIDIAはこのビジョンを「Cosmos 2.5」というツールスイートとして具体化しました。これは「生成」「現実性付与」「推論・評価」「検索」というデータパイプラインの各工程を担う4つの主要コンポーネントで構成されています。

表1. NVIDIA Cosmos 2.5 スタック:シミュレーションから推論まで

3. 【詳細分析】NVIDIA Cosmos 2.5スタックの完全解剖

Cosmos 2.5を構成する各コンポーネントは、フィジカルAI開発におけるデータ生成・検証・改善の各工程を統合的に支える設計となっています。

A. Cosmos Predict 2.5:連続的な世界の生成

Cosmos Predict 2.5は、本スタックにおける「生成エンジン」です。その中核技術は、単一の入力(画像・テキスト・動画)から、物理的・時間的整合性を維持した約30秒のマルチカメラ(multi-view)動画世界を生成する点にあります。

技術的には、従来分散していたText2Video、Image2World、Video2Worldモデルを単一の軽量アーキテクチャに統合することで、効率性と性能の双方を最大化しています。

ここで特に注目すべきは「30秒」という時間スケールです。この30秒は、学習データの質的飛躍を意味します。すなわち、「単純な物理予測」から「複雑な行動シナリオ」の学習への移行を可能にします。

従来の3〜5秒程度の短時間動画生成モデルは、「ボールがどのように跳ねるか」「車がどのようにコーナーを曲がるか」といった即時的な物理因果関係の予測には有効でした。

一方で30秒という時間軸は、より複雑かつ長期的なシナリオを表現可能にします。 例えば、「歩行者が横断歩道に接近(5秒)→接近する車両を認識し躊躇(10秒)→車両の減速を確認し横断を決定(15秒)→安全に横断を完了(30秒)」といった、意図や相互作用を含む時系列データを生成することができます。

このように、30秒の連続世界生成能力は、フィジカルAIを単なる「反応型システム」から、文脈理解や他者の意図予測を行う高度な「推論エージェント」へと進化させるための、最低限必要なデータ単位を提供する点で極めて重要です。

B. Cosmos Transfer 2.5:「超現実性」によるSim-to-Realギャップの克服

Cosmos Transfer 2.5は、Sim-to-Realギャップを解消するための「現実性付与エンジン」です。その中核機能は、NVIDIA Isaac SimやCARLAなどのシミュレータで生成された「粗い」3Dシーンを入力として受け取り、「雨の夜」「濡れた路面」「霧のある環境」といったテキストプロンプトに基づき、写真レベルのリアルな映像へと変換する点にあります。

特筆すべきは、前モデル(Transfer 1)と比較してモデルサイズが約3.5分の1に縮小されたにもかかわらず、処理速度、生成品質、プロンプト整合性といった性能指標がむしろ向上している点です。特に長時間動画生成時におけるエラー蓄積が大幅に低減されており、これは一貫性のある長尺シナリオ生成において極めて重要な改善です。

Cosmos Transfer 2.5のアプローチは、Sim-to-Realギャップ解消における極めて合理的なパイプライン設計を示しています。すなわち、「物理的正確性」と「視覚的リアリズム」を分離して処理するという戦略です。

- 第1段階(物理): Isaac SimおよびNewton Physics Engineは、物理的相互作用の再現に特化し、高速かつ粗い(ただし物理的には正確な)3Dシーンを生成します。

- 第2段階(グラフィックス): Cosmos Transfer 2.5がこれを入力として受け取り、後処理としてリアルな視覚表現を付与します。

この「分離型パイプライン」は、軽量化されたモデルの高速性と組み合わさることで、ほぼ無限に近い視覚的バリエーションを低コストかつ高効率で生成可能にします。これは、Sim-to-Realギャップ解消における最も実用的かつスケーラブルなアプローチの一つです。

C. Cosmos Reason:「認識」から「理解」へ進化したAI評価エンジン

Cosmos Reasonは、Cosmosスタックにおける「頭脳」であり、同時に「品質管理システム」です。約70億パラメータ規模のVLM(視覚言語モデル)として、「推論・認識・マルチモーダル理解」という高度な機能を提供します。

このモデルは、「そこに車がある」といった単純な物体認識を超え、「その車が濡れた路面でスリップし、歩行者に衝突する可能性がある」といった、時空間的因果関係および物理法則の推論を行います。

さらにCosmos Reasonは、NIM(NVIDIA Inference Microservice)として提供されており、開発者は複雑なインフラ構築を行うことなく、この推論エンジンをデータパイプラインに容易に統合することが可能です。

Cosmos Reasonの本質的な価値は、ロボットの「思考エンジン」としての役割にとどまりません。むしろ、大規模に生成される合成データを自動的に評価・選別する「AI批評家」としての機能にあります。

Predict 2.5およびTransfer 2.5によって膨大なデータ生成が可能になる一方、その中には物理的に不可能なシナリオ(例:車両が建物を通過する)や、学習に無意味なデータも含まれます。ペタバイト規模のデータを人手で検証することは現実的ではありません。

この課題に対し、NVIDIAは「AI批評家」という概念を導入しました。Cosmos Reasonは、生成されたビジュアルデータを評価し、適切なスコアリングを行うことで、自動的にデータのキュレーションおよびアノテーションを実施します。これにより、データ品質管理が完全に自動化され、MLOpsパイプラインへと直接接続されます。

D. Cosmos Dataset Search: 月単位の作業を日単位へ

Cosmos Dataset Searchは、この大規模データパイプラインにおける「デバッグおよび反復プロセス」を担うコンポーネントです。その主要機能は、膨大なシナリオデータコーパスから、特定のエッジケースを即座に検索することにあります。

最大の価値は、ポストトレーニングにおけるモデル改善サイクルを、従来の「数ヶ月」から「数日」へと劇的に短縮する点にあります。

これは、「なぜモデルが失敗したのか」という問いに対する答えを、データの中から即時に発見できる、データ中心AIパイプラインにおける「デバッグツール」兼「検索エンジン」として機能します。

例えば、自動運転システムが「豪雨・非保護左折・対向自転車」という特定のエッジケースで重大な失敗を起こした場合を考えます。

- 従来は、エンジニアが手動でシミュレーション環境を構築し、数ヶ月にわたり収集された実走行データを解析する必要がありました。

- 現在では、開発者はCosmos Reason(VLM)を用いて「豪雨、非保護左折、自転車」と自然言語で検索するだけで、Cosmos Dataset Searchがペタバイト規模のデータコーパスから該当シナリオを数千件単位で数日以内に抽出します。

これにより、開発者は抽出された「失敗データセット」を用いて即座に再学習を行うことが可能となります。これはすなわち、

「モデルが失敗 → 該当データを検索 → データセットに追加 → 再学習」

という完全なデータ中心MLOpsループの実現を意味します。

4. 実証事例:Skild AIとServe Robotics

NVIDIAは、本技術が単なるプロトタイプではなく、実運用可能な基盤であることを示しています。 すでに以下の4段階からなる標準パイプラインを提示しています。

NuRec(現実世界の再現) → SimReady Assets(3Dアセット) → Isaac Sim(シミュレーション) → Cosmos(データ拡張)

さらに、このパイプラインの有効性は、先進的な企業による実際の導入事例を通じて実証されています。

A. 事例1:Skild AI(シミュレーションとデータ拡張の統合)

Skild AIの目標は極めて挑戦的です。特定のロボットに限定されない、ヒューマノイド、四足歩行ロボット、ロボットアームなど多様な形態に対応可能な「汎用ロボットブレイン(Omnibody Robot Brain)」の開発を目指しています。

このような「汎用AI」の実現には、極めて高いデータ多様性が求められます。しかし、従来の手動によるシミュレーション構築では、この要件を満たすことは困難です。

Skild AIはこの課題を、NVIDIAのパイプラインによって解決しています。

- まず、Isaac Labを活用し、強化学習のための高性能物理シミュレーション環境において、数千単位のロボットインスタンスを同時に学習させています。

- さらに、Cosmos Transferを用いることで、生成されたシミュレーションデータに対し、照明、背景、テクスチャといった多様な環境変数を付加し、データの多様性を大幅に拡張しています。

これにより、モデルは特定環境に依存しない高いロバスト性(Robustness)を獲得することが可能となります。

Skild AIの共同創業者兼CEOであるDeepak Pathak氏は、その価値を次のように述べています。

「NVIDIA Isaac LabおよびCosmosは、ロボットが実際の経験に基づいて学習するために必要な、大規模かつスケーラブルなデータソースの生成を可能にする。」

この事例は、Cosmosの持つ大規模生成およびデータ拡張能力が、汎用ロボットAIという長期的目標の実現に不可欠であることを示しています。

B. 事例2:Serve Robotics(ハイブリッドデータ戦略の実践)

ラストマイル配送ロボット企業であるServe Roboticsは、すでに1,000台以上のロボットを実際の都市環境に展開し、10万件以上の配送を完了しています。さらに、2025年末までに2,000台への拡張を計画しています。

同社の取り組みは、成熟したフィジカルAI企業がどのようにデータ戦略を設計・運用しているかを示す代表的な事例です。

Serve Roboticsは、「シミュレーション」か「現実データ」かという二項対立ではなく、両者を戦略的に統合するアプローチを採用しています。

まず、実環境で稼働するロボットフリートは、月間100万マイル以上の走行データを収集しており、これは約1,700億件の画像およびLiDARサンプルに相当します。これらは現実世界の膨大なデータ基盤を構成します。

一方で、NVIDIA Isaac Simを活用し、この実データの中で観測された予測困難かつ危険なエッジケースを、シミュレーション環境内で再現し、重点的に学習を行います。

この戦略の本質は以下のように整理できます。

- 現実データ:問題の発見(Problem Discovery)

- 合成データ:問題の解決(Problem Solving)

すなわち、1,700億件の現実データは「モデルがどこで失敗するか」を特定するために活用され、その中で一度しか観測されないような希少なエッジケースを、シミュレーション環境で数百万回規模に再現・変形し、集中的に学習するのです。

この事例は、フィジカルAIにおける最適なデータ戦略が、「現実データ」か「合成データ」かではなく、

「現実データと合成データの統合活用」

であることを明確に示しています。

5. 結論:Cosmosがもたらした「データの洪水」と真の競争領域「データキュレーション」

NVIDIA Cosmos 2.5スタックの登場は、ワールドファウンデーションモデル(WFM)を通じて、フィジカルAI開発における最大の課題であった「データ生成」のボトルネックを解消したことを意味します。

しかし、その結果として新たに浮上した課題が「データ洪水(Data Deluge)」です。

現在、Serve Roboticsのような企業は月間1,700億件規模の現実データを収集し、Cosmos Predictは理論上無限に近い合成シナリオを生成可能です。

このような状況において、競争の焦点は次の段階へと移行しています。

「どれだけ多くのデータを生成できるか」ではなく、 「ペタバイト級のデータの中から、モデル性能に直結する“真の1%のエッジケース”をいかに特定し、選別できるか」

NVIDIA自身もこの課題を強く認識しています。Cosmos Reason(AI評価エンジン)およびCosmos Dataset Search(検索エンジン)をコア機能として組み込んでいることがその証左です。

ただし、これらはあくまで強力な「コンポーネント」であり、データワークフロー全体を統合管理する「プラットフォーム」ではありません。

現実の企業環境では、Cosmosによる生成データ、Isaac Simによるシミュレーションデータ、そして実運用から得られる現実データといった、多様なソースから流入するデータを、単一のパイプライン上で統合的に管理する必要があります。

この文脈において、Superb AIの戦略的価値が最大化されます。

- エンジン vs. ハブ: NVIDIA Cosmosが強力な「データ生成エンジン」であるとすれば、Superb AIのMLOpsプラットフォームは、それらすべてのデータを統合的に管理・精製・ラベリング・分析し、モデルの学習およびデプロイまでを担う「データ中心MLOpsハブ」として機能します。

- キュレーションの核心、Superb Curate : 特に、Superb Curateは、Cosmosがもたらした「データキュレーション」という新たなボトルネックを直接的に解決するソリューションです。Cosmosによって生成された膨大な原始データに対し、AIが自動的にクラス不均衡やシナリオ偏りを分析し、モデル性能に最も影響を与える希少なエッジケースを抽出します。さらに、ラベルノイズを検出し、最も価値の高い「ゴールデンデータセット」を構築します。

NVIDIA Cosmos 2.5は、フィジカルAIにおける「データ生成の時代」を切り開きました。 しかし、この革新の恩恵を最終的に享受するのは、生成されたデータを最も適切に「選別し、管理できる」企業です。

NVIDIA Cosmosのようなワールドファウンデーションモデルと、Superb AIのデータキュレーション基盤は、競合関係ではなく、フィジカルAIという巨大な変革を実現するための本質的に補完的な関係にあります。

複雑化するデータ課題を解決し、フィジカルAIの実用化を加速させる上で、Superb AIは重要なパートナーとなるでしょう。

Superb AIについて

Superb AIは、エンタープライズ向けのAIトレーニングデータプラットフォームであり、ML(機械学習)チームが組織内でトレーニングデータをより効果的に管理・提供できるよう、データ管理の新しいアプローチを提案しています。2018年に発表されたSuperb AI Suiteは、自動化、コラボレーション、プラグアンドプレイモジュールのユニークな組み合わせを提供し、多くのチームが高品質なトレーニングデータセットを準備する時間を大幅に短縮する手助けをしています。この変革を体験したい方は、今すぐ無料でご登録ください。