インサイト

⑨ 米国ビッグテックのフィジカルAI動向(1):NVIDIA vs. Google 戦略分析

Hyun Kim

Co-Founder & CEO | 2026/04/01 | 7 min read

![[フィジカルAIシリーズ#9] 戦略分析 : NVIDIA vs. Google](https://cdn.sanity.io/images/31qskqlc/production/18114f6a912a73279e107860e8f0c55875cb1031-2000x1125.png?fit=max&auto=format)

1. AI革命の新たな局面、「具現化(Embodiment)」の時代

2025年第3四半期の技術的キーワードは、フィジカルAIです。

この期間、NASDAQは20,000ポイントを突破し、テック株主導の力強いラリーが続きました。一方で、2024年末から提起されていた「AIバブル論」やバリュエーションへの懸念も共存し、市場は複合的な様相を呈していました。2025年11月には、NVIDIAの時価総額が5兆ドルに迫り、Google(Alphabet)の株価が300ドルを突破するなど、市場の資本はAIインフラと物理的実装技術を有する企業へ集中する傾向を示しました。

Superb AIのフィジカルAIシリーズ「米国ビッグテックのフィジカルAI分析」では、NVIDIA、Google(Alphabet)、Amazon、Tesla、Metaといった米国主要ビッグテック企業がこの3カ月間に発表した、フィジカルAIに関する主要技術、戦略的パートナーシップ、ハードウェアのリリースを分析します。現在の技術エコシステムは、単なる「チャットボット」競争を超え、工場、物流センター、家庭へと浸透する自律エージェント(Autonomous Agents)とヒューマノイドロボットの時代へ入りつつあります。

本パート1では、現実世界の物理法則をデジタルへ移し替えつつあるNVIDIAと、ロボットに高次の推論能力を与えたGoogleの、2025年3〜4四半期における主要動向を見ていきます。

パート2では、TeslaとAmazonの戦略を分析します。

2. 現実のOSを掌握する:NVIDIAのフィジカルAIインフラ覇権

2025年下半期、NVIDIAは単なるGPUチップメーカーを超え、物理世界のシミュレーションと制御を担うプラットフォーム企業へと完全に進化しました。Jensen Huang CEOは、2025年11月の決算発表およびCES 2025の基調講演などを通じて、「フィジカルAI」が次世代AIの中核的な成長エンジンであることを明言し、それを支える強力なソフトウェアスタックとモデル群を公開しました。

2.1 NVIDIA Cosmos:物理的常識を備えたワールド基盤モデル

NVIDIA戦略の頂点にあるのが、2025年11月に公開されたNVIDIA Cosmosワールド基盤モデル(World Foundation Model)プラットフォームです。既存の言語モデルがテキストの統計的確率を学習してきたのに対し、Cosmosは物理法則、因果関係、そして物体永続性(Object Permanence)を学習することで、ロボットに一種の「物理的常識」を与えます。

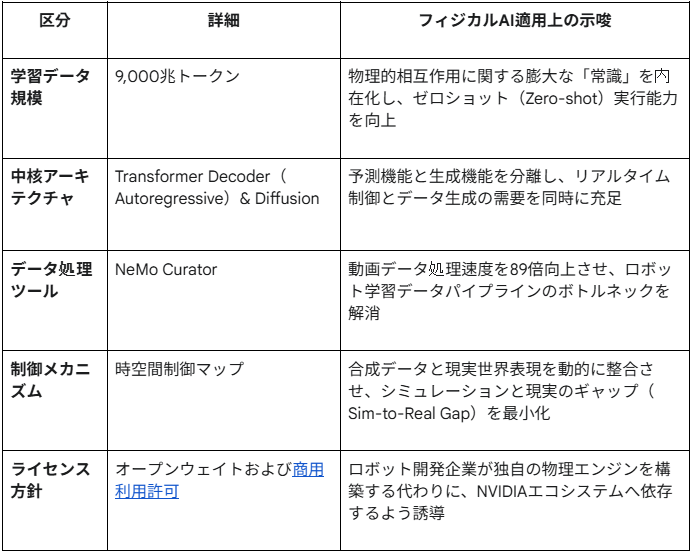

2.1.1 技術アーキテクチャと差別化要因

NVIDIAは、約9,000兆トークン規模のデータを学習させることでCosmosモデルを構築しました。これにより、ロボットは初めて接する環境でも、「このコップを押せば落下して割れるだろう」という未来の状態を予測できるようになります。Cosmosは、以下の2つの中核アーキテクチャで構成されています。

- Cosmos Autoregressive Model(自己回帰モデル):

- 機能: 現在の観測データをもとに、未来の物理的状態を予測します。

- 技術的特徴: Transformer Decoderアーキテクチャをベースとし、3D RoPE(Rotary Position Embeddings)技術を導入することで、空間次元と時間次元を分離してエンコードします。これにより、ロボットは移動する物体の軌道を高精度に予測し、自らの行動が環境に与える影響をシミュレーションできます。

- 応用: 自動運転車やロボットがリアルタイムで経路を計画し、衝突を回避する意思決定プロセスに活用されます。

2. Cosmos Diffusion Model(拡散モデル):

- 機能: テキストプロンプトや簡易的な入力のみで、高解像度かつ物理的に整合した動画を生成します。

- 技術的特徴: 動画圧縮技術とテキスト統合技術を組み合わせることで、ロボット学習向けの合成データを無限に生成できます。

- 応用: 現実世界でデータ収集が難しい危険シナリオ(例:火災現場、衝突事故)をシミュレーションし、ロボットを学習させる用途に活用されます。

[表1] NVIDIA Cosmosワールド基盤モデルの主要仕様と機能

NVIDIAはこれらのモデルをオープンライセンスで提供することで、世界中のロボット開発者がNVIDIAのCUDAおよびIsaacプラットフォーム上でアプリケーションを開発するよう促しています。これは、PC時代のWindows、モバイル時代のAndroidのような「プラットフォーム・ロックイン」効果を、フィジカルAI市場でも再現しようとする戦略と解釈できます。

2.2 「Mega」Omniverse BlueprintとAIスーパーファクトリー

NVIDIAは、ロボット単体を超え、ロボットが稼働する空間である工場全体を知能化する「Omniverse Blueprint」を、2025年10月末に発表しました。これは、デジタルツイン技術を産業現場へ本格適用するためのアーキテクチャです。

- 産業パートナーシップの拡大: Siemens、Foxconn、ToyotaなどがこのBlueprintを採用しました。特にSiemensは、自社のXceleratorプラットフォームとOmniverseを連携させることで、工場設計データがリアルタイムでOmniverseシミュレーションへ反映される仕組みを構築しました。

- 電力・冷却シミュレーション: 注目すべき点は、このシステムが単にロボットの動線だけでなく、工場内データセンターの電力消費や冷却効率までシミュレーションすることです。AIロボットが消費する膨大な電力を管理するため、CadenceのReality Digital Twinプラットフォームとも連携し、熱管理や気流まで最適化します。

- Microsoftとの連携: 2025年11月のMicrosoft Igniteで発表されたとおり、NVIDIAはMicrosoft Azureと協力し、「AIスーパーファクトリー」を構築しています。これは、Azureクラウドインフラ上でOmniverseを稼働させ、OpenUSD(Universal Scene Description)標準を通じて異なる3Dツール間のデータ障壁をなくすことを目指すものです。

2.3 エッジコンピューティングとROS 2エコシステムの掌握

中央の巨大モデル(Cosmos)が脳だとすれば、末端で動作するロボットの神経系はJetson Thorが担います。

- Project GR00TとJetson Thor: NVIDIAは、ヒューマノイドロボット向けチップであるJetson Thor向けのソフトウェアスタック「Isaac ROS 4.0」を、2025年10月にシンガポールで開催されたROSCon 2025で実演しました。これにより、ロボットはクラウド接続なしでも、エッジ側で高度な視覚推論と制御を実行できるようになります。

- Physical AI SIGの設立: NVIDIAは、オープンソース・ロボティクス・アライアンス(OSRA)内に「Physical AI Special Interest Group(SIG)」を設立しました。これは、世界のロボットOSであるROSの標準を定義するグループであり、NVIDIAはこれを通じて、GPUアクセラレーション機能がROS 2の中核標準として定着するよう主導しています。加えて、ロボットの性能ボトルネックをリアルタイムに可視化するGreenwave Monitorツールもオープンソースで公開し、開発者エコシステムを支援しています。

3. 認知エンジンの進化:Googleのマルチモーダル推論とエージェント制御

NVIDIAが物理世界のシミュレーションに注力したのに対し、Googleとその傘下研究組織であるDeepMindは、ロボットが複雑な命令を理解して実行するための「知能」と「ソフトウェア制御」能力に注力しました。

3.1 Gemini 3:ロボットのための空間知能

2025年11月18日、Googleは次世代モデルであるGemini 3を公開しました。Gemini 3は単なる言語モデルではなく、ロボット制御を見据えた高度な空間推論能力を備えています。

- 空間的推論とニュアンス理解: Gemini 3は、「あの散らかったものを片付けて」といった曖昧な命令を理解し、部屋の3次元構造を把握した上で、「散らかったもの」が何を指し、どこへ片付けるべきかを推論できます。

- Gemini Robotics: Googleは、汎用モデルをロボット向けに特化させた「Gemini Robotics」モデルも別途紹介しました。このモデルは、わずか100回のデモンストレーションだけで新しい作業を学習できる「Few-shot Learning」能力を示し、データ不足に悩まされるロボット学習の難題を解く手がかりを提示しました。

3.2 Project Antigravity:エージェント開発の新たなパラダイム

GoogleはGemini 3とあわせて、Project Antigravityという新たな開発プラットフォームも発表しました。これは、フィジカルAIの開発環境を根本から変革するツールです。

- AIエージェントは、コードエディタ、ターミナル、ブラウザを横断して制御できる権限を持ちます。

- 開発者が「赤いボールを持ち上げ、障害物を避けるROS 2ノードを書いてほしい」と自然言語で命令すると、Antigravity内のエージェントがコードを生成し、シミュレータ上でテストし、エラーが発生すれば自律的にコードを修正します。これは、ロボットソフトウェア開発の参入障壁を大幅に引き下げる試みといえます。

3.3 DeepMindの視覚アライメント研究

DeepMindは、2025年11月11日にNature誌へ掲載された「Teaching AI to see the world more like we do(AIに人間のように世界を見せる方法)」という論文を通じて、ロボットの視覚システムを人間の認知構造に整合させる研究成果を発表しました。

- AligNetデータセット: DeepMindは、数百万枚の画像に対する人間の判断データを集約した「AligNet」データセットを構築しました。これにより学習されたモデルは、照明条件が変化したり物体が回転したりしても、同一物体として認識する頑健性(Robustness)が大きく向上しました。

- SIMA 2と仮想世界からの転移: またDeepMindは、No Man's SkyやGoat Simulator 3といったビデオゲーム環境で学習したSIMA 2エージェントも公開しました。このエージェントは、ゲーム内で道具を使い、経路を探索する能力を自律的に学習し、その能力が実世界ロボットのナビゲーションへ転移可能であることを示しました。

NVIDIAとGoogleの戦略は、いずれも「現実世界のデータは高コストである」という前提から出発しています。NVIDIAはCosmosを通じて仮想世界で無限のデータを生成し、GoogleはGemini 3とAntigravityを通じて、少量のデータでもロボットを高度に制御する方法を模索しました。これらの技術は、今後ロボットが「実験室」を離れ、「日常」へ入っていく速度を左右する中核インフラになるはずです。

パート2では、Tesla、Amazon、MS、Figure AIなどにおけるハードウェア戦略と実際の産業適用事例を引き続き見ていきます。

Superb AIについて

Superb AIは、エンタープライズ向けのAIトレーニングデータプラットフォームであり、ML(機械学習)チームが組織内でトレーニングデータをより効果的に管理・提供できるよう、データ管理の新しいアプローチを提案しています。2018年に発表されたSuperb AI Suiteは、自動化、コラボレーション、プラグアンドプレイモジュールのユニークな組み合わせを提供し、多くのチームが高品質なトレーニングデータセットを準備する時間を大幅に短縮する手助けをしています。この変革を体験したい方は、今すぐ無料でご登録ください。